Beschreibung

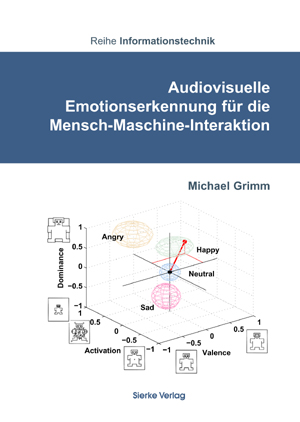

Die automatische Erkennung des Emotionszustandes ist ein aktuelles Forschungsgebiet im Bereich der Mensch-Maschine-Schnittstelle. Eine mögliche Anwendung ist der Einsatz bei humanoiden Robotern im Haushalt. Aber auch in vielen anderen Situationen ist es sehr wichtig, nicht nur zu erfahren, was der Mensch sagt, sondern auch wie er es ausdrückt. In anderen Arbeiten zur Emotionserkennung werden üblicherweise nur einzelne Emotionskategorien untersucht, wie z.B. Ärger, Freude oder Angst. In dieser Dissertation wird ein aus der Psychologie motiviertes Konzept zur Beschreibung von Emotionen in einem dreidimensionalen Emotionsraum verwendet. Darin wird eine Emotion als Zusammenspiel aus drei kontinuierlichen Parametern („Emotionsprimitiven“) aufgefasst: Valenz (negativ – positiv), Aktivierung (ruhig – erregt) und Dominanz (schwach – stark). Für die automatische Emotionsschätzung werden sowohl das Sprachsignal als auch Einzelbilder aus der Videoaufnahme des Gesichts analysiert. Aus der Sprache werden prosodische und spektrale Merkmale extrahiert, wie z.B. die mittlere Sprechhöhe, die Sprechgeschwindigkeit oder die MFCC-Koeffizienten. Die Schätzung der Emotionsprimitive erfolgt dann mittels nichtlinearer Parameterschätzung unter Verwendung von Support Vector Regression (SVR). Die akustische Schätzung wird durch eine Analyse des Gesichtsausdrucks, speziell der Augen- und Mundregion, unterstützt. Die Ergebnisse zeigen, dass mit dem vorgestellten Verfahren Emotionen im Emotionsraum zuverlässig geschätzt werden können. Die Eigenschaften der akustischen und visuellen Emotionserkennung lassen sich vorteilhaft kombinieren.